Задача рекомендательных систем на последовательностях заключается в том, что они хорошо улавливают временные цепочки действий пользователя, но хуже понимают его истинные предпочтения, особенно если данных о человеке мало. Большие языковые модели умеют восстанавливать эти скрытые смыслы, но использовать их напрямую в реальных сервисах ресурсозатратно: один запрос к LLM может длиться более 10 минут. Подход российских ученых решает эту задачу. На этапе обучения модели по истории взаимодействий и текстовым метаданным формируется профиль пользователя — его предпочтения и особенности поведения. Затем он превращается в вектор, с которым выравниваются внутренние представления самой рекомендательной модели. В итоге, когда система выдает рекомендации реальному человеку (на этапе инференса), ресурсоемкая модель уже не требуется.

Проверка на четырех наборах данных показала: добавление LLM-дистилляции к популярным моделям SASRec и BERT4Rec дает устойчивый прирост качества. На датасете ML-20M точность NDCG@10 выросла на 5,62%, а полнота Recall@10 — на 4,74% по сравнению с обычным SASRec. При этом скорость создания рекомендаций оказалась в 190 раз выше (4,37 секунды против 840 секунд) по сравнению с базовым методом IDGenRec на основе больших языковых моделей.

«Большие языковые модели обладают колоссальным объемом знаний о мире и о том, как люди формулируют свои предпочтения. Но использовать их напрямую в рекомендательных сервисах — всё равно что приглашать профессора лингвистики для ответа на каждый вопрос в чате. Наш подход берет у "профессора" самое ценное — понимание глубинных мотивов пользователя — и передает это быстрому и легкому "ассистенту". В итоге человек получает более точные рекомендации без задержек, а бизнес — масштабируемое решение без лишних расходов на инференс», — отметил директор Центра практического искусственного интеллекта Сбербанка Николай Тиден.

Как отмечают авторы, использование решения позволит цифровым сервисам еще лучше понимать предпочтения пользователя. Кинотеатр подберет фильм, который действительно понравится, интернет-магазин покажет нужный товар, даже если клиент еще сам не сформулировал запрос. Компании же получают готовый метод повышать качество рекомендаций без роста вычислительных затрат, перестройки архитектуры и необходимости держать в продакшене тяжелую большую языковую модель. Это особенно важно для крупных промышленных систем, где важна каждая миллисекунда.

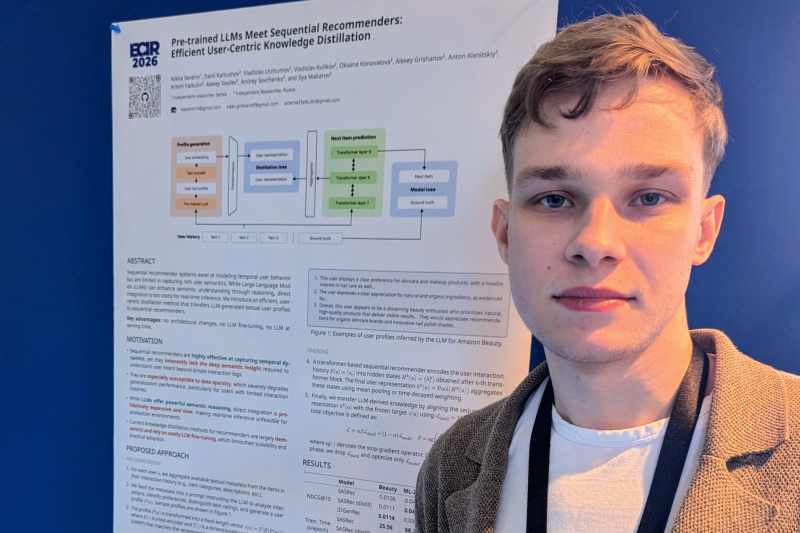

Владислав Куликов на конференции ECIR 2026. Фото предоставлено автором.

Результаты исследования были представлены на Европейской конференции по информационному поиску ECIR 2026 в Делфте, Нидерланды.

«В этом исследовании я работал над созданием пользовательских профилей с помощью LLM: исследовал разные стратегии промптинга, тестировал способы агрегации истории взаимодействий, сравнивал модели и эмбеддеры. Эти профили затем использовались для выравнивания представлений рекомендательной модели, поэтому их качество напрямую влияет на итоговый результат. Работу нашей команды я представлял на ECIR 2026. Во время постерной сессии к нам подходило много исследователей. Они задавали вопросы по нашей статье, делились своими похожими задачами – получился полноценный обмен опытом. Особенно ценно было объяснять свою работу на английском и видеть, что люди из совершенно разных стран и контекстов тебя понимают и хотят разобраться глубже», — рассказал студент программы «Искусственный интеллект» Владислав Куликов.