Автоматы благодати и искусственный интеллект

Машинное обучение является одной из наиболее доступных форм из всего спектра технологий, входящих в очень широкое понятие «искусственный интеллект». Именно эта технология сегодня наиболее изучена, на ее основе создано наибольшее количество инструментов. Искусственный интеллект – свойство интеллектуальных компьютерных систем выполнять творческие функции, которые традиционно считаются прерогативой человека. Об автоматах благодати и любви люди заговорили с 1956 года.

С 1980-х годов в области искусственного интеллекта используется статистический подход, который основывается на понимании того, как учатся дети. Например, ребенок пишет впервые SMS на смартфоне, он только научился печатать и не обращает внимания на ошибки, дети – оптимизаторы и стараются максимально воспользоваться функцией коммуникации – рассказать. Идея статистического подхода состоит в том, чтобы научить компьютер воспринимать окружающую действительность не на основе правил (как это было изначально), а на основе того, как данные воспринимаются и используются окружающей действительностью.

То, что мы видим сейчас в сфере искусственного интеллекта стало возможным за счет изменения подхода к искусственному интеллекту, но также за счет изменения тех условий, которые есть. Речь идет об облачных технологиях (наличии огромного количества дискового пространства, на котором можно хранить много информации, за счет которой искусственный интеллект может обучаться), соединенности и сенсоров (точки входа данных для искусственного интеллекта), которые становятся все более доступными.

Авторы книги «Машина, платформа, толпа» Эндрю Маккафи и Эрик Бриньолфсон говорят о важном изменении: переходе от стандартного партнерства к новому партнерству между машиной и человеком. Идея стандартного партнерства в том, что машины, алгоритмы и роботы выполняют те задачи, которые человек не хочется или не может по каким-либо причинам выполнять. В рамках нового партнерства искусственный интеллект берет на себя те функции, которые, казалось, принадлежат людям – например, принятие решений. Оказалось, что во многих ситуациях, особенно в тех, где человеку свойственны отклонения, где недостаточно данных, где необходимо держать много переменных в голове, человеческое суждение оказывается хуже, чем суждение компьютерное. Если технологии машинного обучения касаются стандартного партнерства, то общий искусственный интеллект уже далеко заходит в новое партнерство, когда технология принимает решения за нас и принимает решения, согласно создателям, лучше человеческих существ.

Машинное обучение применяется в основном для автоматизации тех задач, которые совершаются людьми, – выявление паттернов (повторяющихся ситуаций), диагностирование, классификация, предсказание, рекомендация, распознавание образов, речи, аудио, текстов (многие из этих областей наслаиваются друг на друга). Это те необходимые условия, которые нужны для более интеллигентных машин, чтобы в том числе обучаться самим и лучше осознавать действительность.

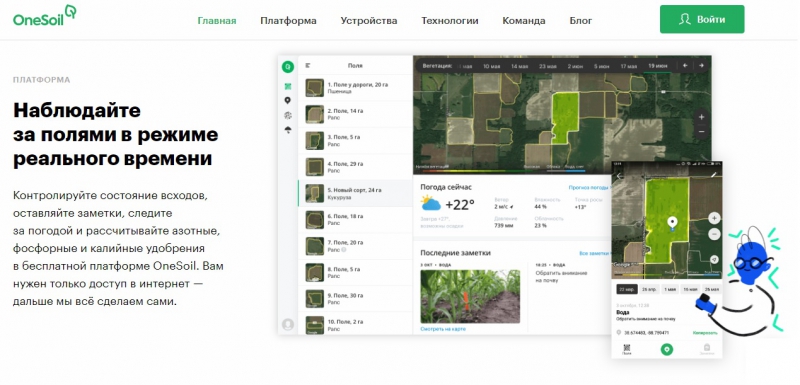

Один из недавних примеров проявления такой технологии – белорусский агростартап OneSoil, который разрабатывает приложения и онлайн-платформу для точного земледелия, которые построены на больших данных и методах машинного обучения. Стартап анализирует аэрофотоснимки, определяя, что растет на том или ином поле на основании известных данных. Так, в одном из эстонских регионов, граничащем с Ленинградской областью, команда выявила, что на полях не растет никакой агрокультуры – только трава.

Для нас машинное обучение доступно в системах распознавания лиц. Перед Чемпионатом мира по футболу в России мэр Москвы Сергей Собянин отчитался, что появилась информация об обнаружении первого преступника с помощью системы распознавания лиц в метро. За последние два месяца таким образом обнаружили девять граждан, находящихся в розыске. В Санкт-Петербурге власти также заказали 80 умных камер с функцией распознавания лиц.

Пример с распознаванием лиц с помощью видеоаналитики хоть и простой, но показательный, потому что долгое время это была задача человека – смотреть видео и пытаться определить, кто на нем. Сейчас удалось эту задачу отдать на откуп технологиям, рассмотреть 800 тысяч видео людей в метро и найти иголку в стоге сена. Но на этом возможности и амбиции «автоматов благодати» не заканчиваются.

Сегодня распространены примеры того, как искусственный интеллект создает по частям крайне реалистичные портреты псевдореальных людей. Есть примеры, когда искусственный интеллект создает изображения, пишет стихи и музыку. Но проблема остается: что бы ни было сделано искусственным интеллектом, это не будет иметь особого смысла для человека, потому что компьютеры до сих пор не могут чувствовать, как мы. Искусственный интеллект работает в своей системе координат, которая нам недоступна (компьютерным системам, в свою очередь, наплевать, доступны ли плоды их творчества нам).

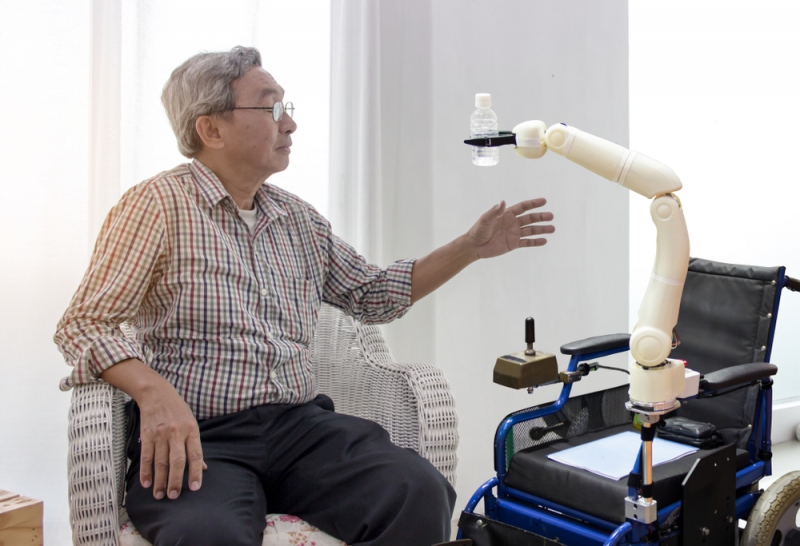

Сюжет нового партнерства – самоуправляющиеся машины с автономией пятого уровня. Идея в том, что, когда у машины достаточно моделей для понимания действительности и достаточно информации об окружающей действительности, мы можем говорить, что «вкалывает робот, а не человек». Происходит ситуация, когда мы не принимаем решения: сначала не принимаем решений, какие повороты сделать, но принимаем решение, куда нужно ехать. Представим ситуацию, когда человеку не нужно решать, куда ехать, – машина знает.

Актуален вопрос о месте человека в переходе от стандартного партнерства к новому партнерству. В драматической форме этот переход показан в коротком видео о роботе Ане. Несмотря на то, что это кажется фантастикой, ситуация, когда машины лучше и быстрее принимают решения, быстрее и начинают принимать решения совершенно в рамках собственной субъектности, кажется, имеет место быть.

Проблемы искусственного интеллекта

Проблемы эмпатии

Вопросы эмпатии и понимание живого существа развиваются позже, чем любые другие возможности, которые более интересны бизнесу или государственным органам – всем, у кого есть ресурсы развития искусственного интеллекта. Роботы не будут считать важным воспринимать наши чувства. Как мы знаем, такие вещи не развиваются самостоятельно, их кто-то развивает.

Проблема этики

Машины, алгоритмы и модели действуют в соответствии с тем, какими их создали разработчики, причем эффект машин, ее алгоритмов, значительно больше, чем эффект конкретных людей. Есть соседи-хамы, политики-хамы, но представим, что их хамство и отсутствие человеческих гуманитарных ценностей распространяется на системы, которые достигают сразу всех.

Ложные корреляции

Человек, который занимается разработкой, может контролировать ошибки. Но представьте, что ошибки, их сложность и быстрота увеличиваются с такой скоростью, которую мы не в состоянии контролировать. Известный пример ложной корреляции – программа, которая распределяла больных в очереди по срочности приема, решила, что астматикам с пневмонией помощь нужна меньше, чем просто людям с пневмонией без астмы. Дело в том, что, по статистике, астматики не умирают, а значит, можно понизить приоритет. На самом же деле в медицинских учреждениях им оказывают помощь в первую очередь – как раз в связи с критическим положением.

Проблема «черного ящика»

Машины, действующие на основе сложных алгоритмов, не хранят все в блоках памяти, как обычные компьютеры. Чем совершеннее алгоритмы (а вы помните, что они постоянно обучаются), тем сложнее расшифровка «черного ящика». Другими словами, тем сложнее понять внутреннюю часть алгоритма, объясняющую, как он приходит к решению.

Учитывая то, как быстро распространяется технология машинного обучения и как она помогает бизнесу и государству, есть интерес, чтобы она активнее проникала в нашу жизнь. Сейчас мы не видим последствий, но ситуацию можно сравнить с примером глобальных технологий, которые создавались в лучших побуждениях: открытие ядерной энергии закончилось подписанием документа о нераспространении ядерного оружия. У технологий долгие циклы жизни, те ошибки, которые будут совершены нами, отразятся на наших детях и внуках.

Чтобы автоматы благодати и любви не превратились в автоматы разрушения или ущемления прав человека, нужно принимать во внимание все особенности развития ИИ.

Искусственный интеллект уже везде, и его уже нельзя остановить.

Искусственный интеллект настолько сложен, что его никто не может понять. Важно быть осведомленным.

Искусственный интеллект не исходит из «человеческой» логики.

Разработчики искусственного интеллекта переносят свои предрассудки на машинную логику. Все те виды дискриминации, что есть у конкретных разработчиков, могут отразиться на результатах их труда.

Искусственный интеллект способен самообучаться. Хочется, чтобы машины были умнее, но до какого предела?

Искусственный интеллект обладает собственной субъектностью. Этот тот вопрос, с которым предстоит столкнуться. Если люди отказывают искусственному интеллекту, который появится, в субъектности, то люди сами нарушают чьи-то права, поэтому мы идем к тому, что будут не только права человека, но и права роботов.

Алексей Сидоренко создал образовательный проект «Теплица социальных технологий»*. Команда проводит хакатоны и митапы в разных городах России, создает бесплатные продукты для НКО, в том числе конструктор для создания сайтов «Кандинский», плагин для сбора пожертвований «Онлайн-Лейка», платформу it-волонтер, сообщество веб-студий «Пасека», которые бесплатно помогают социальным проектам, и онлайн-школу Теплосеть.

*Некоммерческая организация, признанная «иностранным агентом»